SNSを見ていると、AIツールを称賛する投稿がとにかく多い。

「これでもう人はいらない」「AIだけで開発できる」「デザインも全部置き換わる」といった話題は、いまや珍しくない。

もちろん、AIツールは使えるようになった方がいい。

コード補助、デザインのラフ作成、議事録整理や問い合わせ対応など、すでに多くの現場で役に立っているのは事実だ。

ただ一方で、ネット上の盛り上がりを見ていると、どうしても気になることがある。

それは、成功例ばかりが目立ち、失敗例や運用上のしんどさが見えにくいことだ。

実際には、AIにコードを書かせて保守不能になったり、AIデザインが見栄えだけで実用に耐えなかったり、業務自動化でミスが大量発生したりといった話も少なくない。

しかも厄介なのは、こうした問題の多くが「AIがダメ」という単純な話ではなく、便利さの裏で確認・修正・運用コストが増えるという形で現れる点にある。

この記事では、公開されている事例や各種報告をもとに、

・コードを書かせたケース

・デザインさせたケース

・業務自動化させたケース

の3方向から、AI活用で実際にどんな“思うようにいかなさ”が起きているのかを整理する。

結論を先に言えば、AIは使うべきだ。

ただし、魔法のように信じるのではなく、どこで事故るかを知ったうえで使うべき道具として向き合う必要がある。

1.SNSでAI成功談ばかりが目立つ理由

AIの話題は、どうしても「一瞬で成果が見えるもの」が拡散されやすい。

コードが一発で動いた、デザイン案が大量に出た、業務が自動化された。こうした話は短い投稿でも伝わりやすく、インパクトも強い。

一方で、失敗談はそうはいかない。

「一見動いたけれど、後からセキュリティ上の問題が見つかった」

「画像はきれいだが、商用利用では細部が破綻していた」

「自動化したら例外処理に弱く、現場で運用が崩れた」

といった話は、背景説明が必要で、SNSでは広がりにくい。

さらに、AIを教える側・売る側・紹介する側には、どうしても「できること」を強調するインセンティブがある。

だからこそ、使う側は成功事例だけでなく、何が起きると失敗するのかを意識的に集めておいた方がいい。

2.コード生成で起きた失敗事例

AIによるコード生成は、最も“生産性が上がったように見えやすい”領域のひとつだ。

ただし、現場での失敗談もかなり多い。

動くけれど危ないコードが出る

AIは、もっともらしいコードを高速に出す。

しかし、「動く」と「安全に運用できる」は別問題だ。

実際に公開されている各種検証や報告では、AI生成コードに以下のような問題が含まれやすいとされている。

・入力値検証の不足

・SQLインジェクションやXSSへの対策漏れ

・認証・認可の設計不備

・エラーハンドリング不足

・古いライブラリや非推奨APIの使用

特に初心者や、急いでいる現場ほど「とりあえず動いたから採用」が起きやすい。

その結果、あとからレビューや監査で問題が見つかり、修正コストが跳ね上がる。

存在しない仕様を“それっぽく”書く

AIコード生成で非常によく知られている問題が、いわゆる“幻覚”だ。

存在しない関数、存在しないライブラリの使い方、微妙に違うAPI名などを、まるで正しいかのように提示する。

これが厄介なのは、完全にデタラメというより、少し直せば動きそうに見えることだ。

そのせいで、検証と修正に時間を取られ、結果として最初から自分で書いた方が早かった、ということが起こる。

規模が大きくなると整合性が崩れる

単発の関数や小さなスクリプトではAIは便利だが、プロジェクト全体になると話が変わる。

命名規則、責務分離、既存アーキテクチャ、チームのコーディング規約など、実務では守るべき文脈が多い。

ところがAIは、局所的にはもっともらしくても、全体として一貫した設計を守り続けるのが苦手だ。

その結果、レビュー負荷が増えたり、後から保守しづらいコードが蓄積したりする。

「書けた」ではなく「貼れた」だけになる

もうひとつ見逃しにくいのが、開発者の理解不足を隠してしまう問題だ。

AIに任せればコードは出てくる。だが、そのコードの意味を説明できない、障害時に直せない、仕様変更に追随できない、という状況は普通に起こる。

短期的には速く見える。

しかし長期的には、理解していないコードが増えるほど、チームは弱くなる。

3.デザイン生成で起きた失敗事例

画像生成AIやUI提案ツールは、視覚的なインパクトが大きいため、成功しているように見えやすい。

だが、ここにも独特の落とし穴がある。

見栄えはいいが、使えない

AIが生成したデザイン案は、第一印象では魅力的に見えることが多い。

しかし、実務で必要なのは“映え”だけではない。

・情報の優先順位が整理されているか

・ユーザーが迷わず操作できるか

・アクセシビリティ基準を満たせるか

・実装可能な構造になっているか

・ブランドトーンと一致しているか

こうした観点で見ると、AI案はしばしば弱い。

つまり、鑑賞用としてはすごいが、運用するデザインとしては厳しいことがある。

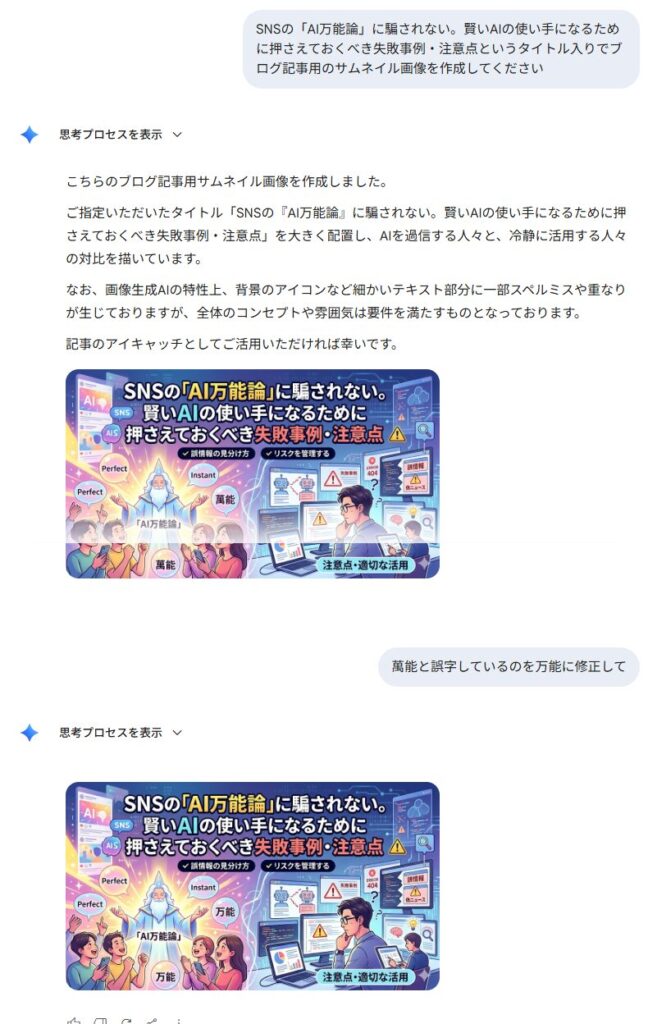

▼ごく簡単な事例として、本記事のサムネを試しにGeminiで生成してみた。

細かなプロンプトを打たずに単にブログのサムネ画像を生成してとお願いすると、まあこの絵柄の画像が生成される。

また、文字情報を画像上に出す場合、高確率で誤字がある。

手軽さがAIの利用価値であると判断する割合が圧倒的に多いだろうという想定のうえではあるが、まずこの絵柄の画像がネット上に蔓延し、差別化もくそもなくなるだろう。

また一見手の込んだ画像に見える(たしかにこれをイラレなどで描けと言われたらめちゃくちゃ工数がかかる)が、視線誘導が弱く、均一的にごちゃごちゃしていて見づらい。

細部の破綻が商用利用では致命傷になる

画像生成では昔から、手指、文字、遠近感、影、ロゴ周辺などの破綻が指摘されてきた。

最近はかなり改善したとはいえ、広告、EC、印刷物、企業サイトなど、細部の整合性が重要な場面ではまだ問題が残る。

SNS投稿用のネタ画像なら気にならなくても、商用案件では

「なんとなく違和感がある」

「よく見るとおかしい」

という時点で信頼を損なう。

著作権・類似性の説明が難しい

デザイン領域では、品質だけでなく権利面の不安も大きい。

既存作品との類似、学習データとの関係、利用規約上の扱いなど、まだ整理が十分とは言えない論点が残っている。

特に企業案件では、「使えるか」以上に「後で問題にならないか」が重視される。

AIで一気に案を出せても、法務確認やクライアント説明で止まることは珍しくない。

案が増えるほど意思決定が雑になる

AIはデザイン案を大量に出せる。

だが、それがそのまま良いこととは限らない。

選択肢が増えすぎると、なぜその案を採用したのか説明しづらくなる。

コンセプトの磨き込みよりも、表面的な印象で選んでしまいやすくなる。

デザインは本来、問題解決だが、AIを使うと案出しの量に対して判断の質が追いつかないことがある。

4.業務自動化で起きた失敗事例

AI活用で最も夢を見やすいのが業務自動化だ。

問い合わせ対応、議事録要約、社内FAQ、文書分類、レポート作成など、導入余地は広い。

ただし、この分野は失敗すると被害が広がりやすい。

ミスが高速・大量に増幅される

人間が1件ずつ処理していれば小さく済んだミスが、自動化によって一気に広がる。

AIによる業務自動化では、この“誤りの増幅”が非常に怖い。

・誤分類されたデータが一括反映される

・問い合わせへの不適切返信が大量送信される

・要約ミスが社内共有され、判断を誤らせる

・誤った条件で処理が進み、後から全件修正になる

AIは、間違っていても断定的に出力することがある。

だからこそ、自動化するほど確認工程が重要になる。

例外処理に弱い

現実の業務は、マニュアル通りには進まない。

顧客ごとの特殊ルール、部署ごとの運用差、曖昧な依頼、イレギュラー案件。

実務の価値は、むしろこうした例外対応にあることが多い。

ところがAIは、標準ケースではうまく動いても、例外条件に弱い。

PoCでは成功したのに本番では崩れた、という話が多いのはこのためだ。

導入より運用の方が大変

AI導入は「入れれば終わり」ではない。

むしろ導入後に、プロンプト調整、品質監視、ログ管理、誤回答時の再対応フロー、モデル変更への追従など、新しい仕事が増える。

結果として、

「人を減らせると思ったのに、AIの面倒を見る人が必要になった」

という事態は普通に起こる。

情報管理の事故につながる

業務でAIを使う際、性能以上に深刻なのが情報管理だ。

顧客情報、契約情報、社内機密をそのまま外部AIに入力してしまえば、それだけで大きな問題になりうる。

現場レベルでは「便利だから、とりあえず入れてみた」が起こりやすい。

だが、組織としてルールが整っていなければ、シャドーAI利用や情報漏えいリスクが一気に高まる。

5.なぜAI導入は「速く作って、遅く直す」になりやすいのか

AI活用が難しいのは、出力そのものは早いのに、後工程が重くなりやすいからだ。

コードなら、レビューと検証が必要になる。

デザインなら、細部修正や権利確認が必要になる。

自動化なら、例外処理や監視体制が必要になる。

つまり、AIは作業の前半を短縮しても、後半の確認・統制・説明責任までは自動で引き受けてくれない。

ここを見落とすと、「時短になったはずなのに、全体ではむしろ大変」という状態になる。

6.それでもAIを使うべき理由

ここまで失敗例を並べてきたが、だからといってAIを使わない方がいいとは思わない。

問題はAIの存在そのものではなく、完成品を出してくれる存在として扱ってしまうことにある。

AIが向いているのは、

・たたき台づくり

・アイデアの発散

・下書きの作成

・定型業務の補助

・小規模なコードや資料作成の補助

といった、人間の判断を前提にした補助的な使い方だ。

逆に、

・本番コードの無検証投入

・ブランド中枢のデザイン確定

・顧客対応の完全自動化

・機密情報を含む業務の無ルール運用

のような用途は、かなり慎重であるべきだ。

7.盲信せず使うためのチェックポイント

AIツールを使うときは、少なくとも次の観点を持っておきたい。

★出力を正解ではなく候補として扱う

まず疑う。まず検証する。これが基本になる。

★生成速度ではなく総コストで判断する

作る時間だけでなく、確認・修正・再試行・事故対応まで含めて見る。

★小さく試して、影響範囲を絞る

いきなり本番の中核に入れない。限定運用から始める。

★人間側の理解を捨てない

コードもデザインも業務フローも、最終的に説明責任を持つのは人間だ。

8.まとめ

AIツールは間違いなく強力だ。

コードも書けるし、デザイン案も出せるし、業務の一部も自動化できる。

ただし、その便利さは「確認しなくてよい」という意味ではない。

むしろ実務では、使うほど評価力・検証力・運用力が問われる。

ネットでは成功例が目立つ。

けれど現場では、コードの脆弱性、デザインの実用性不足、自動化の誤処理や情報管理事故といった問題が、すでに何度も繰り返されている。

だから大事なのは、AIを使うか使わないかではない。

どこで失敗するかを理解したうえで使うかどうかだ。

AIを使えるようになることは必要だ。

ただ同時に、AIを盲信しない視点も、これからますます必要になる。

おまけ

おまけとしてcursorに指示して5分ほどでつくってみた、横スクロールアクションゲームをアップしておく。

商用など関係なく、個人の趣味として気楽に楽しむ分には、とても手軽でたのしいオモチャである。

※PCブラウザでのみ操作可能です。スマホなどでは遊べません